O Facebook manipula as notícias exibidas na rede social, alegam ex-funcionários

O popular site americano de tecnologia Gizmodo fez uma revelação preocupante: ex-funcionários do Facebook, que trabalhavam no departamento de “trending topics” (os tópicos mais populares) da maior rede social do planeta, admitiram que manipulavam notícias exibidas no site. O grande problema é que a empresa sempre defendeu que sua página é completamente neutra. Para um […]

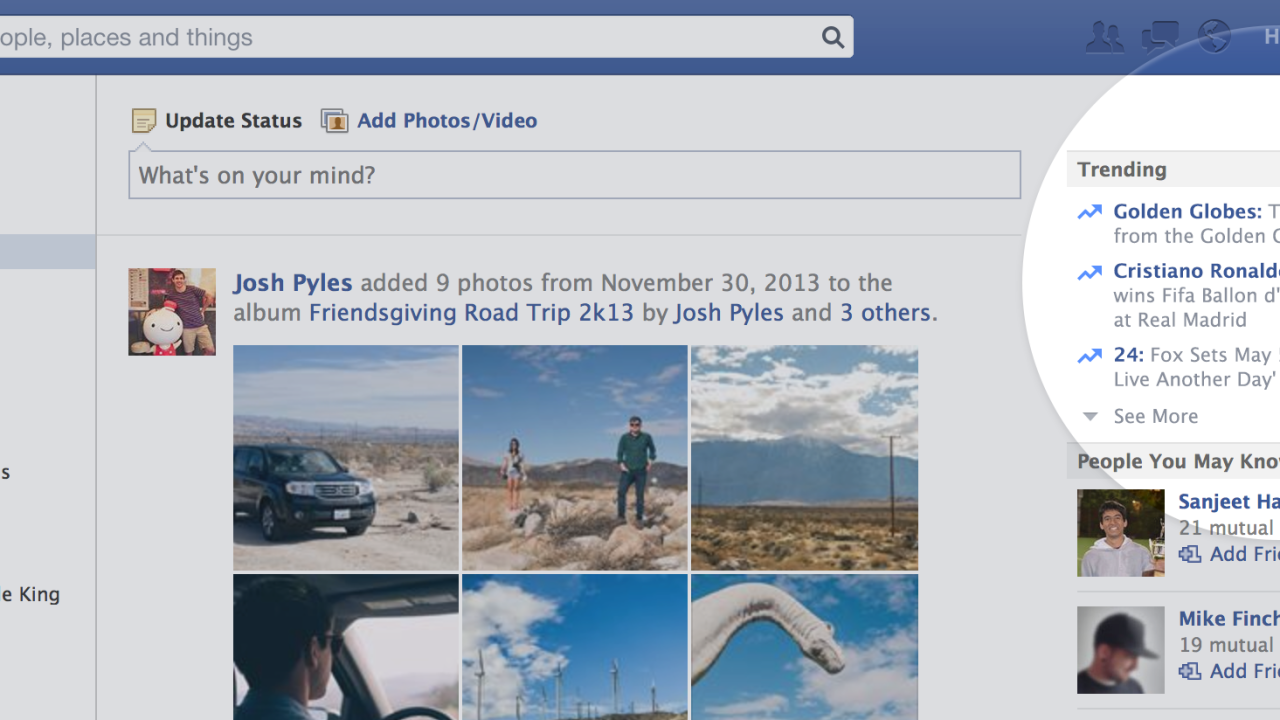

O popular site americano de tecnologia Gizmodo fez uma revelação preocupante: ex-funcionários do Facebook, que trabalhavam no departamento de “trending topics” (os tópicos mais populares) da maior rede social do planeta, admitiram que manipulavam notícias exibidas no site. O grande problema é que a empresa sempre defendeu que sua página é completamente neutra. Para um assunto aparecer no “trending” (os “populares” – influente seção com força para impactar, por exemplo, as próximas eleições presidenciais americanas, neste ano), bastaria que ele tivesse repercussão entre os usuários. Quantos mais fosse citado, mais alto subia na lista de popularidade e, assim, maior destaque ganharia nas timelines das pessoas. Parece, contudo, que não é bem assim.

Segundo relatos coletados pelo Gizmodo, funcionários do Facebook, formados nas melhores universidades americanas, eram encarregados de rotineiramente suprimir histórias de interesse conservador. Da lista seriam excluídas, por exemplo, pautas sobre políticos republicanos, a exemplo de Mitt Romney, que fora candidato à presidência em 2012. Mesmo que essas notícias estivessem, de fato, entre as populares. Ou seja, os usuários eram simplesmente enganados pela rede.

Em destaque: a área de “trending” do Facebook

Em paralelo, o time do Facebook, conhecido internamente como “os curadores de notícias”, tinham de injetar, dentre os “populares”, assuntos considerados relevantes pela companhia. Mesmo que eles não sejam lidos com frequência suficiente pelas pessoas. Ou seja, viram “populares” as pautas de apreço de Mark Zuckerberg (o todo-poderoso fundador e CEO da rede) e seus colegas, não o que é realmente “popular”.

Como exemplo, notícias sobre os conflitos na Síria eram artificialmente infladas dentre da rede, para passar a falsa impressão de que assuntos ditos “sérios” reverberam nesse ambiente virtual (conhecido, convenhamos, mais pelas fofocas e pelas opiniões extremas). “É absolutamente enviesado. Fazíamos tudo de forma subjetiva. Só dependia de quem era o curador naquele momento, e qual era sua opinião”, disse um dos ex-funcionários que resolveram realizar a denúncia ao Gizmodo.

Para agravar ainda mais a situação, relata-se que o trabalho de mídias americanas mais conservadoras, a exemplo do Washington Examiner, também era excluído dos “populares”. Mais: entravam artificialmente na lista as manchetes de sites de peso, a exemplo do New York Times. Uma das razões para isso, além do viés político, seria a competição com o Twitter. A rede dos 140 caracteres é famosa por ser eficiente na divulgação de notícias, em tempo real. O Facebook não queria ficar para trás nisso. Por isso, os “curadores” tinham de destacar as notícias “quentes”, mesmo que elas ainda não tivessem a repercussão necessária para tal.

Os relatos foram feitos por ex-empregados . Porém, tudo indica que a prática continua.

Para entender a gravidade, é como se no Brasil se privilegiassem notícias de um político específico de esquerda, a exemplo das opiniões dos defensores de Dilma Rousseff, em detrimento das ideias de direita. Ou, ainda, como se uma mídia de esquerda tivesse maior privilégio do que uma chamada de direita. Mais: o Facebook manipularia a linha do tempo dos usuários para exibir assuntos de interesse da companhia no Brasil (numa simples contextualização, aqui sem pé no “real,” como a implementação de um projeto da empresa no país).

A edição dos “populares” do Facebook não seria um problema se a empresa admitisse o método. Com isso, assumiria sua intenção de ser uma mídia opinativa, não um campo neutro de discussões (como se vende). Entretanto, ocorre o contrário: a rede social defende que toda a análise do que é popular é feita por um algoritmo, controlado pelos funcionários, porém, sem considerar interesses políticos e afins. Parece que não é bem assim.

Outro lado: Tom Stocky, VP do Facebook responsável pelo departamento em questão, escreveu em seu perfil defendendo que não é real a prática relatada pelos ex-funcionários: “Não permitimos ou aconselhamos nossos revisores a sistematicamente discriminar contra fontes de notícias ou contra ideologias e desenhamos nossas ferramentas para tornar isso tecnicamente impossível”.

Será?

Para acompanhar este blog, siga-me no Twitter, em @FilipeVilicic, e no Facebook.

SEGUIR

SEGUIR

SEGUINDO

SEGUINDO